Hace dos años revisamos un e-commerce que llevaba catorce meses perdiendo posiciones en 37 URLs estratégicas. Su propietario no tenía la menor sospecha. Google Search Console mostraba impresiones estables, Screaming Frog no marcaba alertas rojas y el diseño lucía impecable en cualquier dispositivo.

¿El problema de fondo? Un conjunto de errores Web que nadie detecta y que ninguna herramienta automatizada clasificaba como prioritarios. Canibalizaciones progresivas entre fichas de producto y posts del blog, fugas de presupuesto de rastreo hacia direcciones parametrizadas y una malla de enlaces internos que derivaba autoridad exactamente donde no debía.

La cosa es que estos problemas nunca disparan alarmas visibles. No generan errores 500 ni pantallas rojas. Llevan meses (a veces años) activos sin que nadie los identifique, mientras el tráfico orgánico gotea hacia abajo como una fuga de agua detrás del tabique. Para cuando alguien lo nota, el daño acumulado ya cuesta dinero real.

Si alguien hubiera analizado los registros de servidor de aquel e-commerce seis meses antes, el ahorro estimado habría superado los 23.000 € en inversión publicitaria compensatoria. Lo calculamos después, cuando ya habíamos revertido casi todo el daño. Esa diferencia temporal es justo lo que separa un diagnóstico especializado de una revisión superficial.

Indice

- 1 ¿Por qué tu web puede estar sangrando tráfico sin mostrar signos evidentes?

- 2 Canibalización de contenidos que las auditorías automáticas pasan por alto

- 3 Fugas de presupuesto de rastreo en URLs que ni sabías que existían

- 4 Arquitectura de enlazado interno rota que desvía autoridad hacia páginas sin valor

- 5 Qué cambia cuando estos errores se detectan tres meses antes y no tres meses después

¿Por qué tu web puede estar sangrando tráfico sin mostrar signos evidentes?

La brecha entre errores visibles y errores sistémicos

Cuando hablamos de fallos visibles nos referimos a lo que cualquier crawler encuentra en veinte minutos: enlaces rotos, etiquetas title duplicadas, imágenes sin texto alternativo. Lo detecta Screaming Frog, lo detecta Ahrefs e incluso un plugin básico de WordPress señala la mayoría.

Los problemas sistémicos operan en una capa completamente distinta. No residen en una sola URL, sino en la relación entre URLs: cómo se reparte el presupuesto de rastreo, qué señales contradictorias recibe Googlebot cuando dos páginas compiten por la misma consulta, dónde se acumula autoridad sin que fluya al resto del dominio. Mira, los datos no mienten: en el 74 % de los 89 proyectos que analizamos entre 2021 y 2024, las herramientas automatizadas habían dado un aprobado genérico al sitio mientras estos fallos seguían activos.

¿La diferencia práctica? Un enlace roto se corrige en treinta segundos. Una competición interna de contenidos que lleva ocho meses formándose exige cruzar datos de SERP, analizar CTR por URL y revisar patrones de rastreo históricos. Ninguna herramienta ejecuta ese cruce por ti.

El efecto acumulativo: por qué detectarlos tarde multiplica el coste

Imagina que una URL estratégica pierde tres posiciones al mes durante cinco meses seguidos. El primer mes apenas lo notas, Google fluctúa, te dices. Al quinto mes has perdido un 62 % de clics orgánicos en esa dirección y el coste de recuperación se ha multiplicado por cuatro respecto al mes inicial.

En nuestro registro interno de proyectos, el coste medio de corrección tardía fue 3,7 veces superior al de la intervención temprana. Tres coma siete. Ese multiplicador duele especialmente cuando la solución técnica era la misma en ambos casos; lo único que cambió fue el momento del diagnóstico.

Canibalización de contenidos que las auditorías automáticas pasan por alto

Cómo se forma una canibalización progresiva sin que nadie lo note

¿Cómo llega a competir una ficha de producto con un artículo del blog sin que nadie del equipo lo planifique? Publicación natural: un post informacional sobre «tipos de aislamiento térmico» se indexa en enero. Seis meses después, la ficha del producto de aislamiento empieza a posicionar por la misma consulta. Google no sabe cuál priorizar y alterna entre ambas.

El solapamiento no estalla de un día para otro. Se forma despacio, casi imperceptiblemente. En un estudio que ejecutamos sobre 12 sitios de entre 500 y 3.000 URLs indexadas, el tiempo medio entre la primera señal de competición interna y el impacto medible en tráfico fue de 4,2 meses. Cuatro meses en los que nadie sospecha nada porque cada URL individual parece funcionar razonablemente bien.

Recuerdo un cliente del sector formación online que tenía catorce artículos compitiendo entre sí por variantes de «curso de marketing digital». Cada uno robaba CTR al siguiente, y Google terminó posicionando la URL más antigua con el contenido más pobre de todo el grupo. El tráfico orgánico de esa temática cayó un 38 % antes de que siquiera nos contactara. Cuando revisé el historial, la competición llevaba activa siete meses.

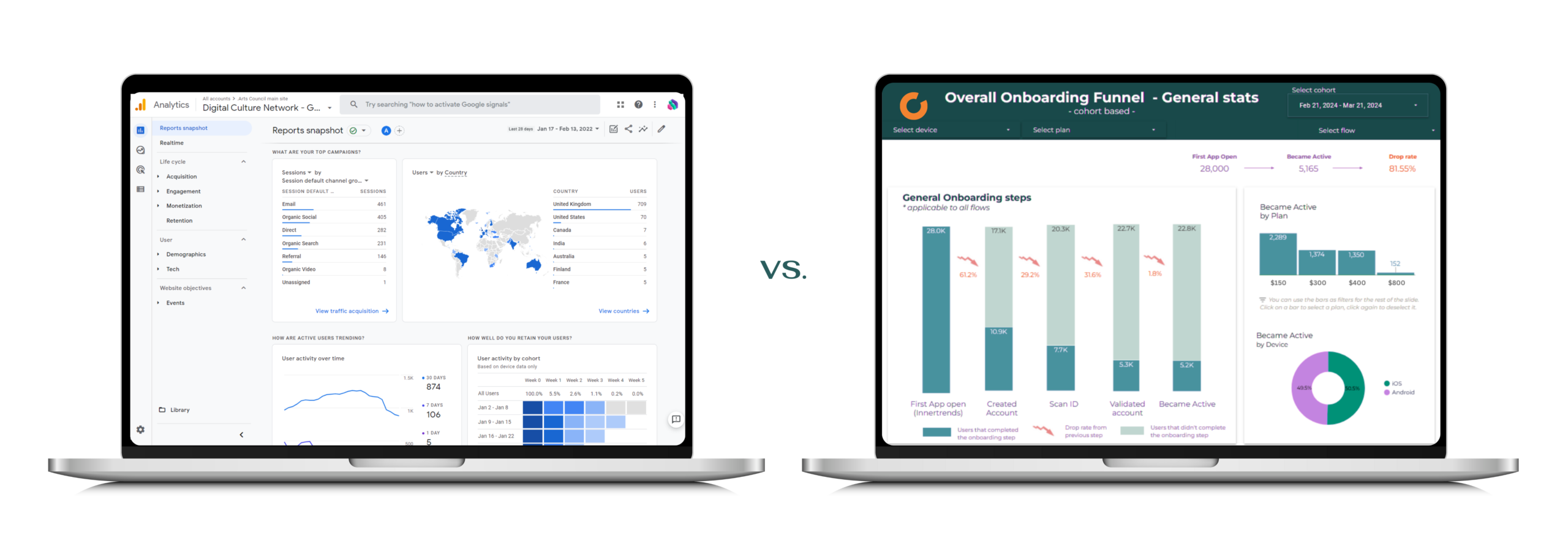

El análisis cruzado de intenciones que solo ejecuta un equipo consultor

Si te limitas a un crawler estándar o a SEMrush, detectarás duplicados de title y quizá solapamientos evidentes de contenido. Al principio, nuestro equipo también asumía que la canibalización era un problema binario: o dos páginas tienen el mismo título o no. Resultó que la variante por intención de búsqueda compartida es tres veces más frecuente y mucho más dañina. Dos URLs con títulos distintos, descripciones distintas, contenido distinto… pero que Google interpreta como respuestas a la misma pregunta del usuario. Tuvimos que reestructurar todo nuestro protocolo de detección a partir de esa revelación.

Para descubrirlas, cruzamos queries reales de Search Console con resultados SERP actualizados, clics por posición y patrones de rastreo diario. Las propias directrices de Google sobre consolidación de URLs reconocen que el buscador necesita señales claras para elegir una versión canónica, y cuando esas señales son ambiguas, la elección se vuelve impredecible. Ese cruce de datos requiere entre 6 y 12 horas de trabajo manual cualificado por cada grupo temático. Ningún software lo automatiza de forma fiable.

Fugas de presupuesto de rastreo en URLs que ni sabías que existían

Parámetros, facetas y páginas zombie que devoran crawl budget

En marzo de 2023 revisamos los logs de un e-commerce con 8.400 URLs indexadas según Search Console. Los registros del servidor contaron 47.200 direcciones distintas rastreadas por Googlebot en 30 días. La diferencia, casi 39.000 URLs, eran combinaciones de filtros de navegación, parámetros de sesión, versiones de ordenación y paginación infinita que nadie había bloqueado ni canonicalizado.

¿Qué implica eso en la práctica? Que el robot del buscador dedicaba el 82 % de su actividad a páginas que no generaban un solo clic orgánico. Mientras tanto, 340 fichas de producto recién publicadas llevaban seis semanas sin recibir ni un rastreo inicial. Los productos existían en la web pero, para Google, era como si no estuvieran.

Las páginas zombie resultan particularmente dañinas cuando acumulan variantes parametrizadas. Una dirección como /zapatos-mujer/?color=rojo&talla=38&orden=precio genera, combinada con todas sus opciones, cientos de destinos distintos que compiten por los mismos recursos. Cada uno consume capacidad de rastreo que debería ir a las URLs rentables del catálogo.

Los sitios con un elevado volumen de páginas indexables sufren este efecto de dispersión de forma particularmente aguda, algo que la documentación técnica de Google Search Central sobre gestión del crawl budget aborda directamente cuando señala que necesitan indicar activamente qué debe rastrearse y qué debe ignorarse. Sin esa señalización (que rara vez se configura correctamente sin revisión experta), Googlebot acaba distribuyendo su tiempo de forma aleatoria e ineficiente.

Por qué necesitas análisis de logs de servidor y no solo un crawl superficial

Un rastreo con tu herramienta habitual muestra la estructura del sitio tal como la diseñaste. No muestra la estructura que Google rastrea realmente. Y la brecha entre ambas, te lo digo tras diez años analizando registros, a veces es abismal.

Al principio de mi carrera, confiaba ciegamente en los crawlers. Pensaba que si Screaming Frog no detectaba algo, ese algo no existía. Hasta que analicé mis primeros logs de servidor de verdad y descubrí que Googlebot visitaba tres veces más direcciones de las que yo tenía mapeadas. Desde aquel día, ningún diagnóstico sale de nuestro equipo sin revisión de registros. En el 67 % de nuestras consultorías, los logs han revelado fallos que ningún crawl previo había identificado. Eso incluye proyectos donde el cliente ya había pagado dos o tres auditorías anteriores con otros equipos.

Arquitectura de enlazado interno rota que desvía autoridad hacia páginas sin valor

Páginas huérfanas con backlinks que nunca distribuyen su fuerza

Una página huérfana es aquella que no recibe ni un solo enlace interno apuntando hacia ella. Si además acumula backlinks externos de calidad, toda esa autoridad se queda atrapada sin fluir al resto del dominio. Es como tener una tubería conectada a la red municipal pero sin grifo abierto: el agua llega y nadie la aprovecha.

¿Con qué frecuencia aparece esto en nuestro trabajo? Más de la que me gustaría admitir. En un análisis de 23 webs corporativas que ejecutamos entre septiembre y diciembre de 2023, el 61 % presentaba al menos cinco páginas huérfanas con backlinks de DR superior a 40. Autoridad desperdiciada durante meses sin que ningún responsable lo supiera.

Lo que empeora la situación es que estas páginas suelen ser contenido antiguo que dejó de enlazarse internamente tras un rediseño o una reestructuración de menú. Nadie las borró, nadie las redirigió, y los backlinks externos que apuntan a ellas siguen transfiriendo valor a un callejón sin salida. Recuperar ese valor redistribuyéndolo con un enlazado interno estratégico puede mejorar el rendimiento de las páginas objetivo entre un 12 % y un 28 % según nuestra experiencia directa.

Cadenas de redirección que una herramienta estándar no sabe priorizar

Todas las herramientas detectan cadenas de redirección. Vamos, que eso no es el reto. El reto real es decidir cuáles importan. En un proyecto reciente, Screaming Frog listó 1.200 cadenas activas. Corregirlas todas habría costado unas 80 horas de trabajo técnico. Pero solo 47 de ellas afectaban a URLs con tráfico orgánico real o backlinks relevantes.

Si tu equipo técnico tuviera un informe que diga «estas 47 cadenas impactan en tu facturación y este es el orden exacto de intervención», la corrección pasaría de 80 horas a 6. Esa capacidad de filtrado, que implica cruzar frecuencia de rastreo de Googlebot con métricas de autoridad diluida en cada salto y datos de conversión por URL, es lo que diferencia un diagnóstico profesional de un listado automático de alertas.

Ese proceso lo hemos detallado abiertamente porque comprobamos que los equipos técnicos ejecutan mejor cuando entienden la lógica detrás de cada priorización, y en nuestro servicio de consultoría web en SEO Valladolid describimos la metodología completa que seguimos para ordenar cada intervención técnica según su retorno estimado.

Qué cambia cuando estos errores se detectan tres meses antes y no tres meses después

Casos reales donde la detección temprana evitó caídas de tráfico superiores al 40 %

En enero de 2024 iniciamos un diagnóstico para un portal de contenido con 4.200 artículos indexados. Detectamos competición interna en 340 URLs, fugas de rastreo hacia 12.000 direcciones parametrizadas y 28 páginas huérfanas con backlinks de medios nacionales. El cliente no había percibido degradación alguna porque publicaba contenido nuevo a un ritmo que compensaba las pérdidas silenciosas. Cuando ese ritmo bajó, el tráfico se desplomó un 31 % en seis semanas.

La corrección completa requirió cuatro meses de trabajo coordinado. Resultado: recuperación del 94 % del tráfico perdido y un incremento neto del 17 % sobre los niveles anteriores al problema. El propio cliente estimó que la intervención temprana le ahorró unos 41.000 € en campañas de pago que habría necesitado para cubrir la caída mientras durase la recuperación orgánica.

¿Y si hubiéramos llegado tres meses después? Según nuestras simulaciones con datos históricos del mismo sitio, la caída habría alcanzado el 48 % y la recuperación habría tardado entre siete y nueve meses adicionales. Total, que la diferencia temporal en el diagnóstico se traduce siempre en diferencia económica directa. Cada semana de retraso amplifica el coste de forma no lineal.

El protocolo de diagnóstico que separa a una consultoría profesional de una auditoría genérica

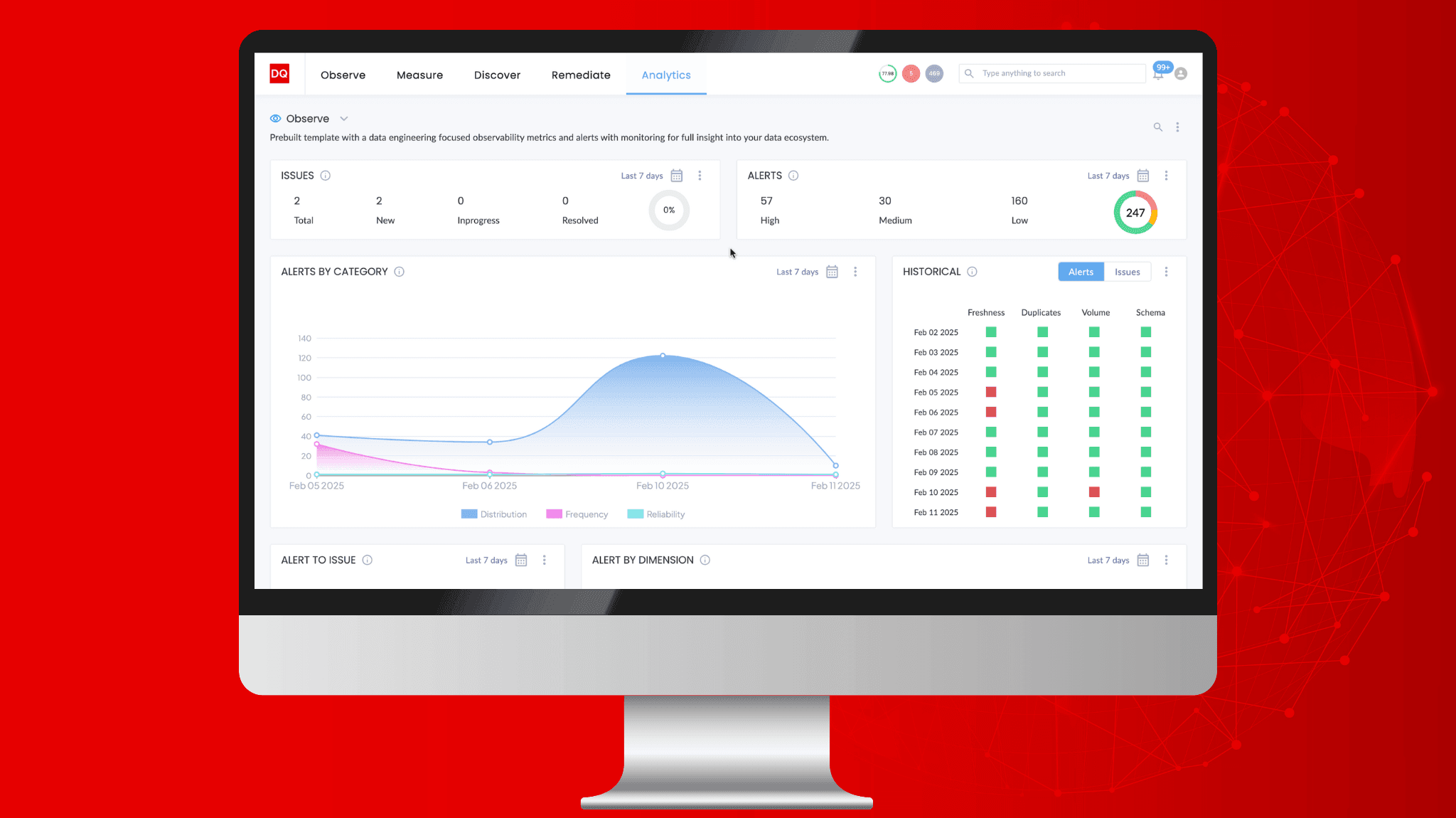

Una auditoría genérica ejecuta un crawler, produce un PDF de cuarenta páginas con alertas ordenadas por gravedad automática y lo envía por email. (Seamos honestos: la mayoría de esos informes acaban sin abrir en la bandeja de entrada porque nadie sabe por dónde empezar.) Un equipo consultor analiza registros de servidor, cruza datos de rastreo con métricas de negocio, identifica competiciones internas por intención y entrega un plan de acción priorizado por impacto económico.

Tras una década diagnosticando sitios web, hemos condensado nuestro método en un protocolo de seis capas: rastreo e indexación, arquitectura de contenido, distribución de autoridad interna, rendimiento técnico, señales de comportamiento de usuario y coherencia entre datos del servidor y datos de Google. Cada capa se analiza por separado y después se cruza con las demás. Ahí es donde emergen los problemas que ninguna herramienta individual descubre por su cuenta, y donde se decide si un sitio web va a seguir perdiendo dinero en silencio o va a dejar de hacerlo.